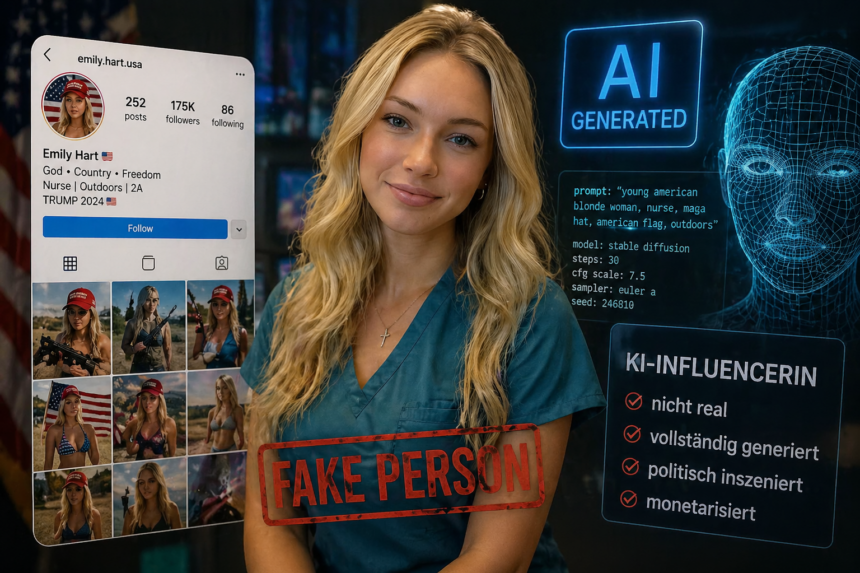

MAGA statt Mensch: Die erfundene Trump-Influencerin „Emily Hart“ und das Geschäft mit KI-Propaganda

Die blonde Amerikanerin mit Cowboyhut, Bikini und Schusswaffe wirkte auf den ersten Blick wie eine typische konservative Social-Media-Influencerin aus den USA. Sie postete patriotische Botschaften, sprach über Religion, Waffenrechte und Donald Trump, posierte beim Angeln, auf Schießständen oder mit Bierdosen vor amerikanischen Flaggen. Hunderttausende Interaktionen später stellte sich heraus: „Emily Hart“ existierte nie.

Hinter dem viralen Profil steckte laut mehreren internationalen Medienberichten ein 22-jähriger Medizinstudent aus Indien, der mithilfe generativer KI eine vollständig künstliche Persona aufgebaut hatte. Die Geschichte sorgt derzeit weltweit für Diskussionen über Desinformation, digitale Täuschung und die wirtschaftliche Macht synthetischer Influencer.

Eine Kunstfigur für maximale Aufmerksamkeit

Die Figur Emily Hart wurde gezielt für ein konservatives US-Publikum entworfen. Laut dem Magazin WIRED analysierte der Betreiber zunächst, welche Inhalte auf Plattformen wie Instagram, Facebook und Fanvue besonders stark performen. Anschließend entwickelte er eine virtuelle Persönlichkeit, die möglichst viele emotionale Trigger vereinen sollte.

Emily Hart präsentierte sich als:

- konservative Krankenschwester

- gläubige Christin

- Unterstützerin der MAGA-Bewegung

- Befürworterin des Waffenrechts

- Gegnerin von „Wokeness“ und Migration

Die Inhalte waren bewusst stark emotionalisiert. Viele Beiträge kombinierten politische Botschaften mit sexualisierten Bildern. Genau diese Mischung sorgte offenbar für enorme Reichweite.

Innerhalb kurzer Zeit erreichten einzelne Videos Millionen Aufrufe. Der Account gewann zehntausende Follower und entwickelte sich zu einer wirtschaftlich erfolgreichen KI-Marke.

Wie der Betreiber Geld verdiente

Besonders bemerkenswert ist die geringe Produktionszeit. Der Student erklärte in Interviews, er habe oft weniger als eine Stunde täglich investiert, um neue Inhalte zu erstellen. Möglich wurde das durch moderne KI-Werkzeuge für Bilderzeugung, Textgenerierung und automatisierte Content-Produktion.

Die Einnahmen kamen laut den Berichten aus mehreren Quellen:

- kostenpflichtige Inhalte auf Plattformen wie Fanvue

- Werbeeinnahmen durch Reichweite

- Verkauf von Merchandise

- exklusive KI-generierte Bilder und Videos

- Affiliate- und Community-Modelle

Der Betreiber sprach von mehreren tausend US-Dollar Umsatz pro Monat. Unabhängig verifizieren lassen sich diese Zahlen zwar nicht vollständig, mehrere Medien bestätigen jedoch übereinstimmend, dass das Projekt erhebliche Einnahmen erzielt haben soll.

Warum die Figur funktionierte

Der Fall Emily Hart zeigt vor allem, wie stark soziale Netzwerke inzwischen auf emotionale Identität reagieren. Die Inhalte mussten nicht besonders komplex sein. Entscheidend war, dass sie eine klar erkennbare Zielgruppe emotional bestätigten.

Der Betreiber selbst erklärte laut verschiedenen Berichten, eine liberal ausgerichtete Version der Figur habe deutlich schlechter funktioniert. Die konservative Variante dagegen erzeugte wesentlich mehr Bindung, Interaktion und Zahlungsbereitschaft.

Medienforscher beobachten seit Jahren, dass Algorithmen stark polarisierende Inhalte bevorzugen. Künstliche Influencer verschärfen dieses Problem zusätzlich, weil sie:

- rund um die Uhr Inhalte produzieren können

- keine echte Identität besitzen

- beliebig an Zielgruppen angepasst werden können

- keine moralischen oder sozialen Hemmungen haben

Die technische Qualität solcher KI-Figuren hat inzwischen ein Niveau erreicht, bei dem viele Nutzer künstliche Bilder kaum noch erkennen können. Wissenschaftliche Untersuchungen warnen deshalb vor einer wachsenden Zahl synthetischer Fake-Profile und KI-gesteuerter Desinformationskampagnen.

Der größere Trend hinter Emily Hart

Emily Hart ist kein Einzelfall. Bereits heute entstehen weltweit tausende virtuelle Influencer, KI-Models und automatisierte Creator-Accounts. Manche werden offen als digitale Kunstfiguren vermarktet, andere bewusst als reale Personen inszeniert.

Der Unterschied im Fall Emily Hart lag vor allem in der politischen Zuspitzung. Die Figur war nicht nur Unterhaltung oder Marketingprojekt, sondern ein hoch emotionalisiertes Identitätsprodukt. Genau dadurch wurde sie wirtschaftlich erfolgreich.

Experten sehen darin eine neue Phase der Plattformökonomie: Nicht mehr reale Menschen stehen im Mittelpunkt, sondern algorithmisch optimierte Persönlichkeiten, die exakt auf Reichweite und Monetarisierung zugeschnitten werden.

Die Affäre zeigt außerdem, wie stark Vertrauen im Netz erodiert. Wenn künstliche Personen überzeugender auftreten als reale Influencer, geraten klassische Kriterien wie Authentizität, Herkunft oder Glaubwürdigkeit zunehmend unter Druck.

Warum der Fall relevant ist

Der Fall Emily Hart ist mehr als nur eine kuriose Internetgeschichte. Er verdeutlicht, wie einfach sich heute politische Milieus, emotionale Bedürfnisse und digitale Communities mit KI-Technologie kommerziell ausnutzen lassen.

Besonders problematisch daran ist:

- Nutzer wussten oft nicht, dass die Person künstlich war

- politische Botschaften wurden gezielt emotional aufgeladen

- Plattformen erkannten den Fake erst spät

- monetäre Interessen standen klar im Vordergrund

Mehrere Accounts der Figur wurden inzwischen wegen betrügerischer Aktivitäten entfernt. Die Debatte über Regulierung, Kennzeichnungspflichten und KI-Transparenz dürfte dadurch weiter an Fahrt gewinnen.